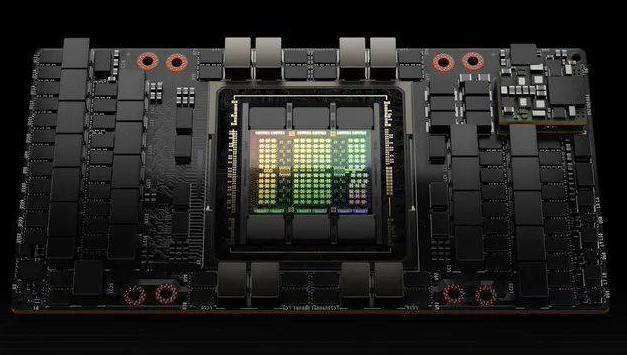

导读 随着人工智能的快速发展,对于计算能力的需求也正在快速增加,英伟达AI处理器H100目前在全球市场都非常畅销。但是每一块维持100的峰值功耗就达到700瓦

随着人工智能的快速发展,对于计算能力的需求也正在快速增加,英伟达AI处理器H100目前在全球市场都非常畅销。但是每一块维持100的峰值功耗就达到700瓦,已经超过了普通美国家庭的平均功耗。随着大量的H100部署到全球各地,专家预测其总功耗将会和一座美国大城市的用电量不相上下,甚至还会超过一些欧洲的小国家。法国施耐德电气公司在2022年的10月份就曾做出预测,用于AI应用的数据中心总功耗目前已经和塞浦路斯全国的用电量相当。

版权声明:本文由用户上传,如有侵权请联系删除!